İlk mikro işlemci kabul edilen Intel 4004 üzerinden 50 yıl yani yarım yüzyıl geçmiş durumda. Bu 50 yıl yonga dünyasında büyük devrimlerin ve atılımların yaşandığına şahit oldu. Özellikle Moore yasasının ortaya atılması bu ilerlemenin temelini oluşturdu.

Gelişmeler inanılmaz ama ya sonra?

Intel şirketinin kurucularından Gordon Moore’un her 18 ya da 24 ayda bir tümleşik devre üzerinde yer alan transistör sayısının ikiye katlanacağını ve verimliliğin artacağını söylediği Moore Yasası sayesinde yonga teknolojilerinde de bir yarış başladı.

Intel 4004 işlemcisi 2300 transistör barındırmaktaydı ancak bugün Nvidia GA100 biriminde 54 milyar transistör yer alıyor. Üstelik 7nm gibi oldukça gelişmiş süreçleri konuşuyoruz. Önümüzdeki yıllarda süreçler 1nm seviyesine inerken transistör sayıları da katlanarak artacak.

Ne var ki bu hızlı gelişme beraberinde çok büyük bir riski de getiriyor. Araştırmacıların radyoaktif bozulma olarak tanımladığı bu risk işlemcilerin çalışma şeklinde büyük bir deformasyona sebep olabilir.

Facebook yonga mühendislerinin geçtiğimiz Şubat ayında yayınladığı bir rapor, gerekli tedbirler alınmazsa işlemci dünyasında büyük bir sıkıntının baş göstermek üzere olduğunu belirtiyor.

Fark edilmeyen veri bozulmaları

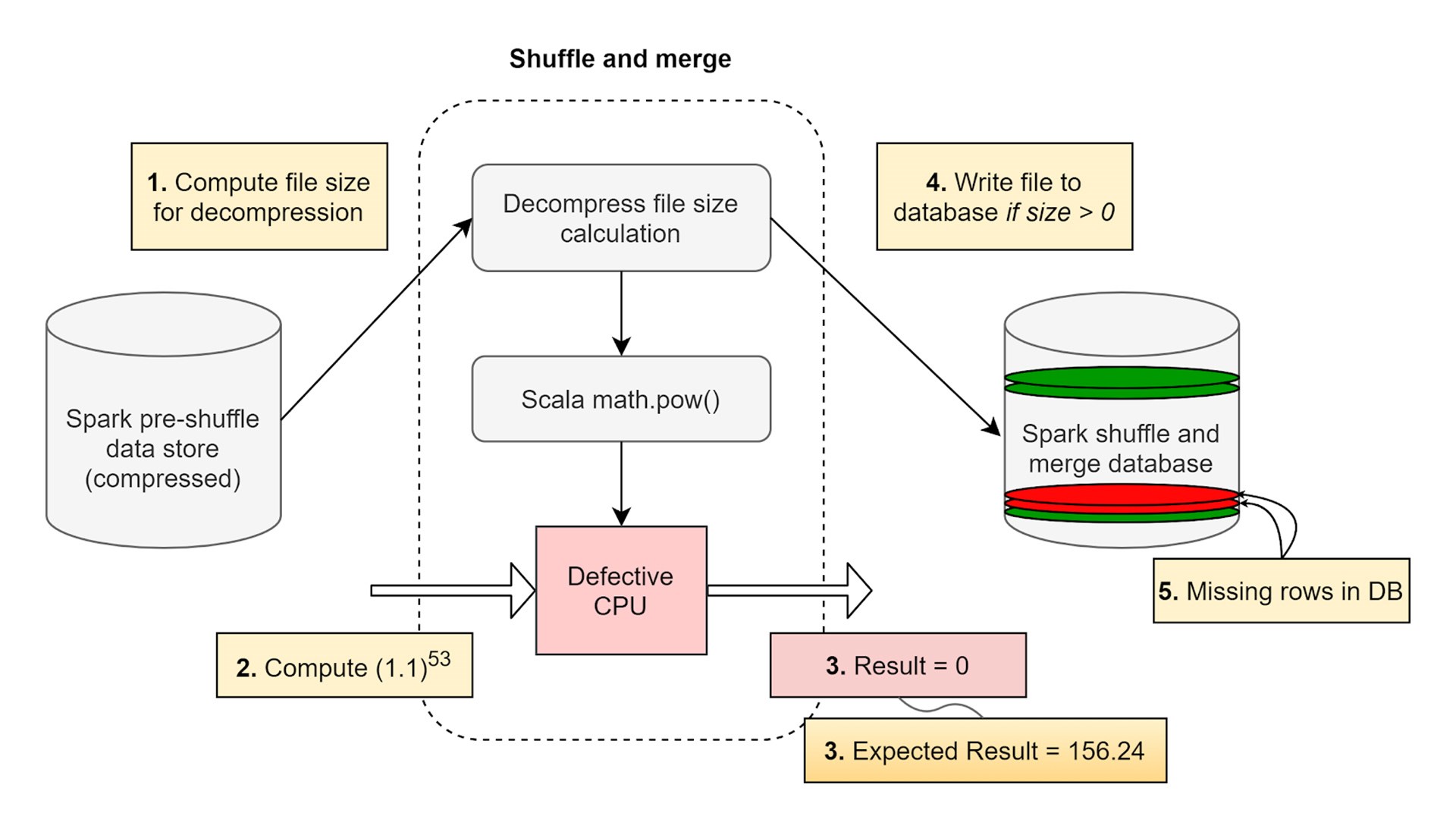

Fark edilmeyen veri bozulmaları olarak da tanımlanan ve SDC (Silent Data Corruption) olarak kısaltılan veri hatası son dönem işlemcilerinde gözlemlenmeye başladı ve uygulama seviyesinde işlemlerin düzgün bir şekilde yürümesine engel oluyor veya hatalara sebep oluyor.

Araştırmacılar 3 yıl gibi bir süreç içerisinde Facebook’un devasa sunucu çiftliklerinde araştırmalar yapmış ve bunun 18 ayı veri bozulmalarını test etmekle geçmiş. Rapor veri bozulmalarının olası senaryoları üzerine ve sonrasında etkileri ile ilgili daha detaylı raporlar da yayınlanacak.

Üretim süreçlerinin gelişmesi ile birbirine çok yaklaşan transistörlerde elektronların rahat hareket alanı kalmadığı için kozmik radyasyondan etkilenmeye başladığı ifade ediliyor. Bu etki bir Bit değeri 0 iken 1 gibi gösterebiliyor ya da 1 iken 0 gibi gösterebiliyor.

Raporda 2+3 şeklinde işlemciye verilen bir komutun veri bozulmaları nedeniyle 6 sonucunu çıkarabileceği belirtilmiş. Ya da bir Facebook kullanıcısının veri tabanından çağırdığı veri normalde sıfırdan büyük bir boyutta iken hata nedeniyle 0 gibi görünüyor ve uygulama hata veriyor ya da veriyi silinmiş gibi davranıyor. Verilerin sıkıştırılması, kodlama dilleri arasında dönüştürme gibi pek çok uygulama bundan etkilenebiliyor.

Milyarlarca veri işleyen sunucularda ya da yapay zekâ işlemleri gerçekleştiren sistemlerde bu tür veri hatalarının çok kritik sonuçlar doğurabileceği ifade ediliyor. Yapılan testlerde yüzlerce sunucu işlemcisinin bu hatadan etkilendiği tespit edilmiş. İşin kötü tarafı mevcut sistemlerin net olarak bu bozulmaları tespit edebilmesi de mümkün değil.

Ortak akıl şart

Hata düzeltme sistemi – ECC olan SRAM ürünlerinde bu hataların belirli bir düzeyde düşük kaldığı görülmüş ancak CPU tarafında bu pek mümkün olmadığı için belirlenmiş ortalamaların üzerinde hatalar ortaya çıkmış.

Veri hatalarının üretim aşamasındaki testler esnasında gözden kaçabileceği gibi kullanıma giren bir işlemcide ilerleyen dönemlerde ortaya çıkabileceği de belirtiliyor. Ya da ömrünü tamamlamış işlemcilerin de bu hataları gösterebileceği dile getiriliyor.

Uzmanlar veri bozulmalarını ayıklayabilmek için derleyici optimizasyonu, harici kütüphanelere bağımlılığın azaltılması, istek dışı dallanmaların azaltılması, gereksiz komut setlerinin giderilmesi gibi tavsiyelerde bulunuyor.

Donanım tarafında veri bozulmalarına karşı tedbir alabilmek için korunaklı veri yolları, özel test süreçleri, mimari tarafta öncelikleri yeniden belirlemek ve ölçeklendirme yapan müşteriler ile sürekli temas halinde olmak tavsiye ediliyor.

Son olarak raporda yonga sektörünün bu hataların ortaya çıkmaması için iş birliği halinde olması ve hem donanım tarafında hem de yazılım tarafında yeni süreçler ortaya koyarak problemin üstesinden gelinmesinin gerekliliğine vurgu yapılıyor.

İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu

1 Kişi Okuyor (0 Üye, 1 Misafir) 1 Masaüstü GENEL İSTATİSTİKLER

13538 kez okundu.

25 kişi, toplam 26 yorum yazdı.

HABERİN ETİKETLERİ

veri, sdc ve