Bu yılın I/O geliştirici konferansında öne çıkan pek çok konu vardı ancak en önemli gelişme biraz perde gerisinde kaldı. Google’ın geçen yıl geliştirmeye başladığı yapay zekaya yönelik Tensor işlemci birimi önemli bir performans sıçraması sağladı.

Yapay zeka çok farklı

Bilindiği üzere Google’ın pek çok hizmeti makine öğrenme dilini temel alıyor çünkü milyarlarca kullanıcının davranışlarını takip etmek ve alışkanlıklarını hedef alan odak reklamlar veya öneriler sunmak o kadar kolay olmuyor. Sayısız algoritma perde arkasında çalışarak on milyarlarca işlem gerçekleştiriyor ve biz kullanıcılar ise alışkanlıklarımıza göre ekrana gelmiş bir reklama veya öneriye tıklamakla yetiniyoruz.

Bu matematiksel işlemler için çok güçlü sistemlere ihtiyaç var. Günümüzde kullanılan ana akım işlemci ve ekran kartları ile bu işlerin üstesinden gelecek sistemler kurmak çok zor. Kurulsa bile devasa sunucularda ve veri merkezlerinde barınmak zorunda. Bunun maliyeti de çok büyük oluyor.

Firmalar bunun yerine özel işlemci geliştirmenin yollarını arıyor. En son Nvidia Volta mimarisinde zar alanında özel yapay zeka çekirdekleri görmüştük. Google da kendi özel yapay zeka işlemcisini geliştiriyor.

TPU yani Tensor Processing Unit anlamına gelen özel tasarımlı işlemci geçen yıl I/O 2016 konferansında tanıtılmıştı. 2004 yılında aldığı radikal kararla sunucu sistemlerinde ve veri merkezlerinde Cisco gibi firmaların ürünlerinden uzaklaşarak kendi donanımlarını kullanmaya karar veren Google, bu konuda çok önemli adımlar attı. TPU işlemcisi Go oyununda şampiyon Lee Sedol'a rakip olarak çıkan sistemde de yer almıştı.

Google için hayati önemde

Tensor işlemcileri firmanın Haritalar hizmetinden tutun Inbox ve Assistant gibi hizmetlere kadar pek çok platformun arka planında yer alıyor. Yine Google’ın geliştirdiği TensorFflow yazılımı, tek bir API üzerinden ilgili sistem üzerindeki tüm işlemci ve GPU'ların kullanılmasını sağlıyor. Yazılım ve donanım olarak kontrolü eline alan Google, bu sayede daha hızlı geliştirmeler yapıyor. Örneğin TPU işlemcisinin sisteme entegre edilerek çalışmaya başlaması 22 gün sürüyor. Yani ihtiyaca yönelik çok hızlı çözüm geliştirilebiliyor.

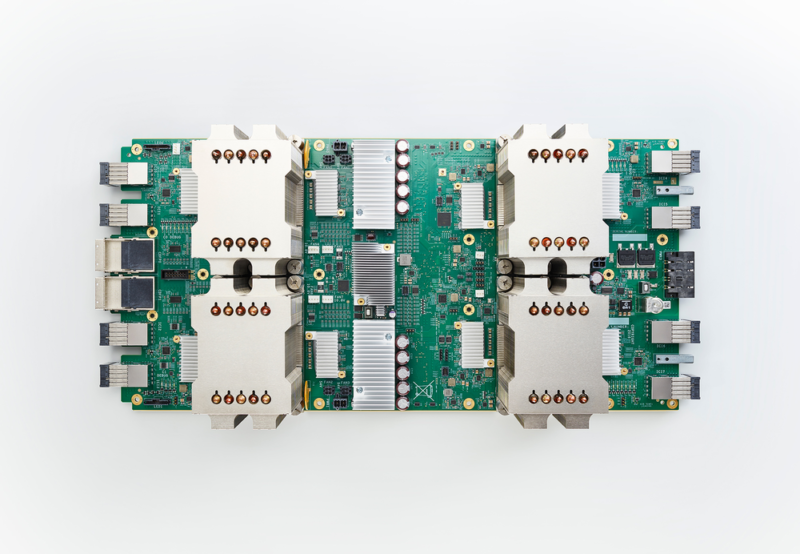

Bu yıl ise Google’ın ikinci nesil Tensor işlemcileri geliştirdiğini duyurdu. Yeni Tensor işlemciler 45 TFLOPS seviyesine ulaşabiliyor. Bunlardan 4 tanesi Tensor modülünde bir araya geldiğinde ise 180 TFLOPS 16-bit işlem performansı elde ediliyor.

Örneğin AMD’nin yeni Vega Frontier ekran kartı 16-bit olarak 25 TFLOPS işlem gücüne ulaşıyor ancak bu karşılaştırma pek uygun değil. Zira Google’ın işlemcisi yapay zekaya yönelik işlem performansı ortaya koyuyor. Genel amaçlı birimlerin performansı ise daha farklı. Bu noktada Nvidia’ya gitmek gerek zira Volta tabanlı Tesla V100 hızlandırıcısı 180 TFLOPS yapay zeka işlem performansı elde edebiliyor. Bu aslında daha anlaşılır bir karşılaştırma.

Google, Pod adını verdiği kartlarda 64 adet Tensor modülü kullanıyor. Böylece performans 11.5 PFLOPS seviyesine çıkıyor. Google yapay zeka için kullanılan tipik CPU ve GPU modellerine göre 80 kata kadar daha yüksek enerji tasarrufuna imza attığını belirtiyor.

Google yaklaşık iki yıldır işlemcilerini veri merkezlerinde kullanıyor. Raf tipi sunucuların sabit disk yuvasına saığabilen bu işlemciler kendi aralarında da çok hızlı bir şekilde haberleşiyor. Sunucuların rastgele olarak birbiri ile haberleşmesi 10Gb/sn hızında oluyor.

Yeni nesil Tensor işlemcilerin diğer bir önemli avantajı her iki iş yükü için optimize edilmesi. Yani hem öğrenme hem de sonuca ulaşma için kullanılabiliyor. Önceki nesilde her iş yükü için ayrı ayrı işlemci belirleme ihtiyacı da ortadan kalkmış oluyor. Bunun maliyete yansıması ise ciddi boyutlarda olacaktır.

Elbette Tensor işlemcilerin yapay zeka yüklerini tek başına kaldırabilmesi mümkün değil. Google henüz o aşamaya gelemedi. Halen Tesla P100 veya Tesla V100 gibi hızlandırıcılara ihtiyaç duyuluyor. Bununla birlikte yakın gelecekte Google’ın bu sorunu da aşacağını söylesek yanılmış olmayız.

İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu

20 sene önce yerli ve milli tüfek bile üretemeyen ülkeden bugün dünyanın konuştuğu savunma sanayi projelerini gerçekleştiren ülkeye. Hamdolsun.