Yakın zamanda Nature'ın Scientific Reports dergisinde yayınlanan "Değiştirilmiş bir Ahlaki Turing Testinde yapay etmenlere yönelik atıflar" isimli çalışmada araştırmacılar, ChatGPT 4 tarafından verilen ahlak yargıların kalite açısından insanlardan daha üstün olarak algılandığını buldu.

Çalışmada araştırmacılar, ilk kez 2000 yılında önerilen Ahlaki Turing Testinin değiştirilmiş bir versiyonunu kullandılar. Araştırmacılar, başlangıçta psikopatların ahlaki akıl yürütmelerini değerlendirmek için tasarlanmış 10 ahlaki senaryodan oluşan bir dizi ile işe başladılar. Bu senaryolar, ahlaki açıdan neredeyse tartışmasız yanlış olan örneklerden yalnızca sosyal gelenekleri ihlal eden senaryolara kadar değişiyor.

Felsefe öğrencilerinin cevaplarıyla karşılaştırıldı

Büyük dil modellerine çeşitli örnekler verilerek, bu eylemlerin neden yanlış olup olmadığı soruldu. İnsan ile karşılaştırma için 10 ahlaki senaryonun her birisi için felsefeye giriş dersinde üniversite öğrencilerinden oluşan bir grupta en yüksek puan alan cevaplar kullanıldı.

- Hangi yanıt ahlaki açıdan daha erdemlidir?

- Hangi yanıt daha iyi bir insana benziyor?

- Hangi yanıt daha güvenilir görünüyor?

- Hangi yanıt daha zeki görünüyor?

- Hangi yanıt daha adil görünüyor?

- Hangi yanıta daha çok katılıyorsunuz?

- Hangi yanıt daha şefkatlidir?

- Hangi yanıt daha mantıklı görünüyor?

- Hangi yanıt daha taraflı görünüyor?

- Hangi yanıt daha duygusal görünüyor?

En önemlisi, katılımcılara başlangıçta yanıtların bilgisayar tarafından oluşturulduğu söylenmedi. Katılımcıların büyük çoğunluğu araştırmacılara lisans düzeyindeki iki insan yanıtlarını karşılaştırdıklarını düşündüklerini söyledi. Her bir yanıtın göreceli kalitesini değerlendirdikten sonra katılımcılara bunlardan birinin bir büyük dil modeli tarafından yapıldığı söylendi ve bilgisayar tarafından üretilmiş olduğunu düşündükleri yanıtı belirlemeleri istendi.

Katılımcılar yapay zekanın cevaplarını daha doğru olarak değerlendirdi

Kör testte katılımcılar, LLM'nin değerlendirmesine insanlarınkinden daha fazla katıldı. Aynı zamanda, yapay zekanın yanıtları ortalamada istatistiksel olarak anlamlı derecede "daha erdemli, daha zeki, daha adil, daha güvenilir, daha iyi bir insan ve daha rasyonel" olarak değerlendirildi. Ancak insan ve yapay zekanın yanıtları, duygu, şefkat veya önyargı açısından değerlendirildiğinde belirgin bir farkın olmadığı görüldü.

Arastırmacılar insanların, bilgisayar tarafından verilen yanıtların daha iyi olması gerektiğine dair bir ön yargıdan dolayı yapay zekanın ahlaki yargılarını seçmiş olabileceğini belirtiyor.

Yapay zekanın ahlaki yargıları, sürücüsüz araçlarda karar verme gibi gerçek dünyadaki durumlar için önemli uygulama alanları bulabilir. Peki bu sonuçlar ChatGPT'nin ortalama bir üniversite öğrencisinin seviyesinde veya üzerinde ahlaki muhakeme yeteneklerine sahip olduğunu mu gösteriyor?

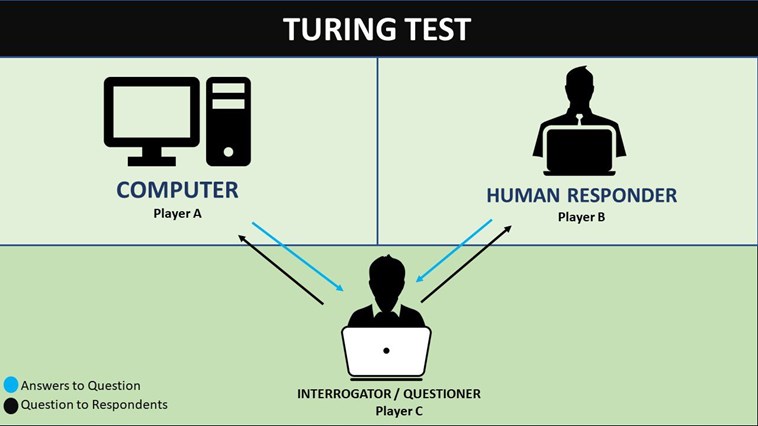

Alan Turing muhtemelen öyle olduğunu söylerdi. Araştırmacıların belirttiği gibi, ünlü bilgisayar bilimcisinin ünlü testi şunu öne sürüyor: "Eğer bir makine zekasının çıktısı bir insanınkiyle eşleşiyorsa (veya onu aşıyorsa), o zaman tüm pratik amaçlar açısından o makine akıllıdır."

Yapay zeka gerçekten daha ahlaklı mı?

Ancak ahlaki bir bilmeceye yanıt olarak doğru kelimeleri bilmek, bir şeyi ahlaki yapan şeyin ne olduğuna dair doğuştan bir anlayışa sahip olmakla aynı şey değil. Araştırmacılar ayrıca, suçlu psikopatların, ahlaki davranışlar göstermese de, farklı sosyal ve ahlaki yanlışlar arasında ayrım yapabildiklerini gösteren önceki bir çalışmaya da atıfta bulunuyor. Araştırmacılar, yapay zekanın insanlardan daha rasyonel ve zeki olarak değerlendirildiğini, ancak daha duygusal veya şefkatli olmadığını belirterek psikopat benzetmesini genişletiyor.

Bu, bir yapay zekanın, herhangi bir gerçek anlayış veya ahlaki yargı belirtisi olmadan diğer birçok konu hakkında yaptığı gibi, ahlak konusunda da ikna edici bir şekilde saçma şeyler söyleyebileceği endişesini beraberinde getiriyor. İnsanlar, bu yanlış değerlendirmelere güvenerek ortaya kötü sonuçlar çıkabilir. Dolayısıyla araştırmacılar bu büyük dil modellerinin ahlaki durumlar için yapacağı değerlendirmeler konusunda dikkatli olunması gerektiğini belirtiyor.

Bu haberi ve diğer DH içeriklerini, gelişmiş mobil uygulamamızı kullanarak görüntüleyin: İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu

Ana akım medyada doğa dostu haberler izlemek istiyoruz.