Büyük dil modelleri (LLM) teknoloji dünyasını fethederken, yapay zeka (AI) araştırmacıları hala kaputun altındaki işlevsellikleri ve yetenekleri hakkında çok fazla şey bilmiyorlar. OpenAI, yayınlanan makalesinin ilk cümlesinde "Dil modelleri daha yetenekli hale geldi ve daha yaygın olarak kullanılmaya başlandı, ancak nasıl çalıştıklarını anlamıyoruz" diyerek bunu açıkça itiraf ediyor.

Neden çalıştıklarını bilmiyoruz

Ancak bir sinir ağının bireysel nöronlarının çıktılarını üretmek için birlikte nasıl çalıştığını tam olarak "bilmeme" durumunun iyi bilinen bir adı bulunuyor: Kara kutu. Yani, mevcut durumda yapay zeka sistemlerinden bir şeyler istiyoruz ve onlar da bir bizlere bir cevap veriyor, fakat bu iki işlem arasındaki süreçte (kara kutu) ne olduğu bir gizem.

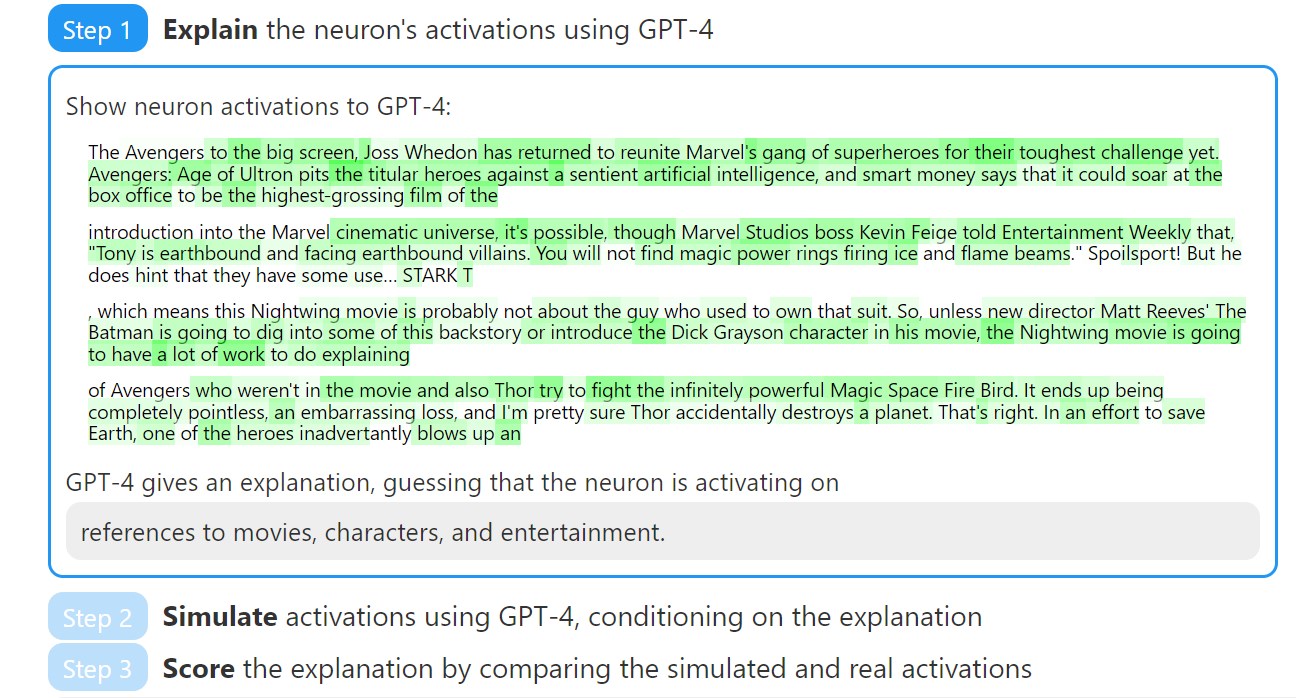

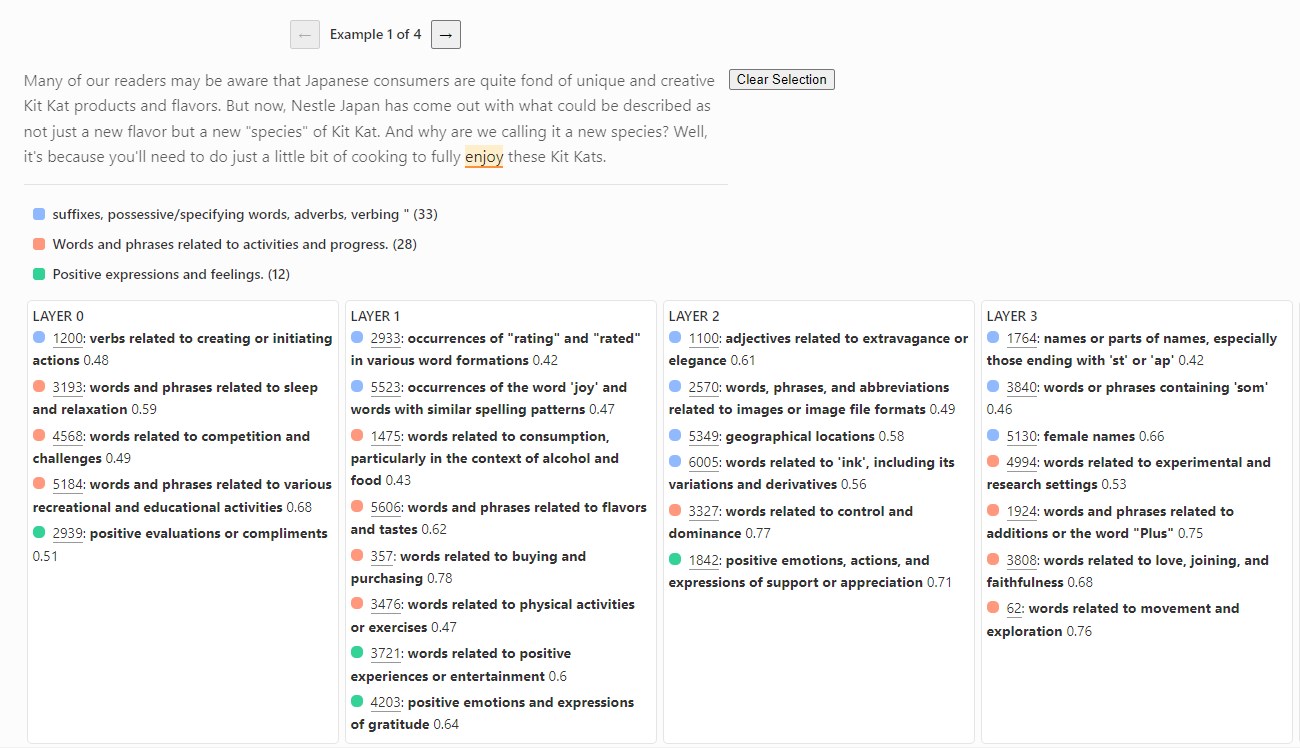

Kara kutunun içine bakmak amacıyla OpenAI'daki araştırmacılar GPT-4 dil modelini kullanarak GPT-2 gibi çok daha az karmaşık bir dil modelindeki nöronların davranışları için doğal dil açıklamaları oluşturdu ve değerlendirdi. Teoride, yorumlanabilir bir AI modeline sahip olmak, bu sistemlerin istendiği bir şekilde çalışmasına katkıda bulunabilir.

Çalışma şekilleri anlaşılabilirse eksiklikleri giderilebilir

OpenAI araştırmacıları, yapay zeka modelleri daha gelişmiş hale geldikçe, üretilen açıklamaların kalitesinin artacağını ve bu karmaşık sistemlerin iç işleyişine dair daha iyi bilgiler sunacağını umuyor. OpenAI, araştırma makalesini, her adımın örnek dökümlerini içeren, metnin vurgulanan kısımlarını ve bunların belirli nöronlara nasıl karşılık geldiğini gösteren etkileşimli bir web sitesinde yayınladı. Firma çalışmalarına devam edeceğini belirtiyor.

Eğer “yorumlanabilirlik” alanında istenen başarı sağlanırsa o zaman ChatGPT ve diğerlerinin neden bir şeyler uydurduğunu anlayabilir ve bu kritik sorun çözülebilir. Zira bu, tıpkı insanların hastalandıklarında tedavi edilmeleri gibi bir süreç. Bir sorunumuz varsa hastaneye gider muayene olur ve teşhis konulur. Teşhis konulunca da buna göre ilaç verilir. Şimdilik yapay zeka modellerini kesin doğrulukla “muayene” edemiyoruz.

Kaynakça https://openaipublic.blob.core.windows.net/neuron-explainer/paper/index.html https://arstechnica.com/information-technology/2023/05/openai-peeks-into-the-black-box-of-neural-networks-with-new-research/ Bu haberi ve diğer DH içeriklerini, gelişmiş mobil uygulamamızı kullanarak görüntüleyin: İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu

1 Kişi Okuyor (0 Üye, 1 Misafir) 1 Masaüstü GENEL İSTATİSTİKLER

19357 kez okundu.

29 kişi, toplam 31 yorum yazdı.

HABERİN ETİKETLERİ

OpenAI, chatgpt ve